Token, context window, sıcaklık, halüsinasyon — bu dört kavram, bir LLM’den ne bekleyip ne beklememeniz gerektiğini belirliyor. ChatGPT, Claude veya Gemini’yi her gün kullananların çoğu için yapay zeka bu araçlardan ibaret. “LLM nedir?” diye sorduğunuzda aldığınız cevap genellikle “yapay zeka işte” oluyor. Bu, araba kullanan birinin “motor nedir?” sorusuna “arabayı çalıştıran şey” demesine benziyor. Teknik olarak doğru, pratik olarak işe yaramaz; çünkü LLM’in verdiği çıktı beklediğiniz gibi olmayınca, hatanın neden kaynaklandığını analiz etmenize imkan tanımaz.

LLM — Large Language Model (Büyük Dil Modeli) — yapay zekanın kendisi değil, yapay zekanın bir alt dalıdır. Devasa miktarda metin verisiyle eğitilmiş, dil üretme ve anlama konusunda uzmanlaşmış bir model. Bu dört kavramın anlaşılması, aynı aracı kullanarak daha iyi bir sonuç almayı sağlar.

1. Token (Jeton): LLM’in Okuma Birimi

LLM’ler kelimelerle değil, token‘larla çalışır. Bir token bazen bir kelime, bazen bir hece, hatta bazen sadece bir karakterdir. “Merhaba dünya” iki kelime ama üç-dört token olabilir. Türkçe gibi eklemeli diller daha fazla token tüketir; “kullanılamayacaklarından” tek kelime ama birden fazla token.

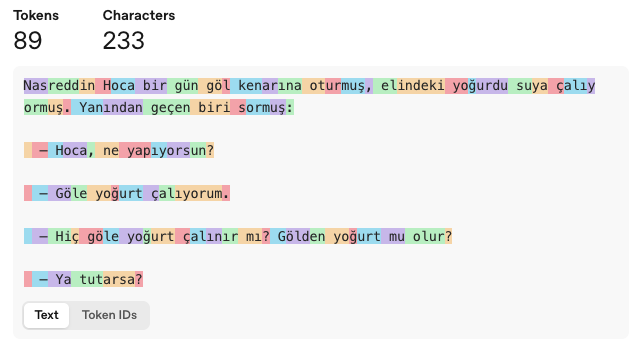

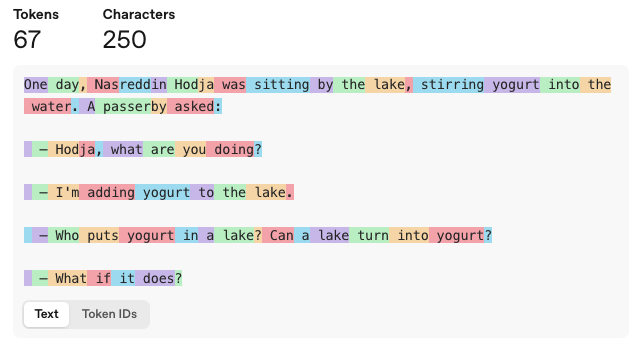

Bu farkı Nasreddin Hoca’nın “Ya Tutarsa?” fıkrası üzerinden inceleyelim:

Aynı fıkra, benzer karakter sayısı (233’e 250) ama Türkçe versiyonu 89 token, İngilizce versiyonu 67 token. Bu örnekte Türkçe kullanmak, aynı şeyi söylemek için yaklaşık %33 daha fazla token harcıyor — oran modelden modele ve tokenizer’dan tokenizer’a değişse de fark her zaman belirgindir. (OpenAI Tokenizer ile kendi metinlerinizi test edebilirsiniz.)

Bunun bir sebebi Türkçenin eklemeli yapısı: “oturmuş”, “elindeki”, “sormuş” gibi kelimeler birden fazla tokena bölünürken, İngilizcede “sitting”, “asked” gibi kelimelerin karşılıkları genellikle tek token. Ama sebep sadece dilin yapısı değil, daha temel bir sebep var: bu modellerin eğitim verisinin büyük çoğunluğu İngilizce metinlerden oluşuyor. Tokenizer — yani metni tokenlara bölen algoritma — İngilizce kelime ve kalıpları çok daha verimli temsil edecek şekilde optimize edilmiş durumda. Türkçe gibi eğitim verisinde daha az temsil edilen diller, bu sebepten dolayı da daha fazla tokena bölünüyor.

Neden önemli: Fiyatlandırma, hız ve context — hepsi token cinsinden ölçülür. Uzun bir prompt yazdığınızda, ya da daha doğrusu aynı uzunlukta bile olsa daha fazla token içeren bir prompt yazdığınızda, daha fazla kaynak harcıyorsunuz. Aynı işi daha az tokenla anlatan kişi daha ucuza daha hızlı sonuç alıyor.

2. Context Window (Bağlam Penceresi): Kısa Süreli Hafıza

Context window, LLM’in bir seferde görebildiği toplam token sayısıdır — hem sizin yazdıklarınız hem de modelin ürettikleri dahil. Bu pencere dolduğunda ne olacağı, kullandığınız araca göre değişir:

- Eski bilgi sessizce düşer. Konuşmanın başındaki mesajlar bağlamdan çıkarılır. Model artık onları “görmez”, dolayısıyla hatırlayamaz.

- Yeni sohbet başlatmanız istenir. Bazı arayüzler sınıra ulaşıldığında doğrudan “Context doldu, yeni bir sohbet başlatın” uyarısı verir.

- Bağlam özetlenerek küçültülür. Daha gelişmiş sistemler, mevcut konuşmanın özetini çıkararak context’i sıkıştırır ve konuşmayı sürdürmenize olanak tanır — ama bu süreçte detaylar kaçınılmaz olarak kaybolur.

Context window boyutu araçtan araca değişir: bazı modeller 200K token sunarken, bazıları 1M hatta 2M tokene kadar çıkabiliyor (2M token yaklaşık 1.500.000 kelime, yani 6.000 sayfalık bir kitap). Üstelik aynı modelin API’si ile sohbet arayüzü farklı limitler sunabilir. Kulağa devasa geliyor ama orta büyüklükte bir kod projesinin tamamı bu pencereyi rahatça dolduruyor.

Neden önemli: Context window dolduğunda LLM, konuşmanın başında söylediklerinizi “unutmaya” başlar. Uzun bir sohbette cevapların tutarsızlaşması, daha önce verdiğiniz talimatı görmezden gelmesi — bunların sebebi genellikle budur. “Az önce söylemiştim neden hatırlamıyorsun?” dediğiniz an, muhtemelen context window sınırına dayanmışsınızdır.

Ama asıl ilginç olan şu: context window içinde olunması bile tüm verinin hatırlanacağını garanti etmez. Bilgi hâlâ pencerenin içindedir ama model onu bulamayabilir. Araştırmalar, modellerin konuşmanın en başındaki ve en sonundaki bilgilere çok hakim olduğunu, ancak ortada kalan kısımda hata yapmaya meyilli olduğunu gösteriyor.

Bunu pratikte test eden kullanıcılar bile var: sohbete başlarken “Her sabah saat 09:26’da kahvemi içerim” gibi rastgele bir bilgi veriyorlar. Konuşma uzadıkça ara ara “Kahvemi saat kaçta içiyorum?” diye soruyorlar. Model bu bilgiyi hatırlayamadığı an, context’in artık güvenilir olmadığını anlıyorlar ve yeni bir sohbet başlatıyorlar. Türkçede kullandığımız “samanlıkta iğne aramak” deyiminde olduğu gibi — ve bu testin adı da gerçekten bu: Needle in a Haystack (Samanlıktaki İğne). Modelin uzun bir bağlam içine gizlenmiş tek bir bilgiyi bulup bulamadığını ölçen bu test, context window’un boyutunun tek başına yeterli olmadığını kanıtlıyor.

“Ama ChatGPT beni hatırlıyor, geçen hafta söylediklerimden bahsediyor bana?” diye düşünebilirsiniz. Bazı ürünler context window’un ötesinde Memory (Hafıza) veya Project Memory gibi kalıcı katmanlar sunuyor. Bunlar konuşmalar arasında taşınan bilgi parçacıkları — adınız, tercihleriniz, tekrarlayan talimatlarınız gibi. Ama bu hafıza da sihirli değil: kaydedilen bilgiler cevap üretilirken bağlamın bir parçası olarak context window’a ekleniyor. Yani sonuçta yine aynı pencere sınırlarına tabi.

3. Temperature (Sıcaklık): Yaratıcılık Düğmesi

Temperature, LLM’in cevaplarındaki rastgelelik seviyesini belirler. Düşük sıcaklık (0’a yakın) daha öngörülebilir, tutarlı cevaplar üretir. Yüksek sıcaklık daha yaratıcı ama daha riskli çıktılar verir. Üst sınır modele göre değişir: OpenAI ve Google modelleri 0-2 aralığında çalışırken, Claude 0-1 aralığında kalır.

Aynı promptu farklı sıcaklıklarla deneyelim — “Baharın gelmesi ile bir programın yeni versiyonunun çıkması arasındaki ilişkiyi bir cümle ile anlat”:

Temperature 0: “Tıpkı baharın doğaya yeni bir canlılık ve tazelik getirmesi gibi, bir programın yeni versiyonu da kullanıcılara hataların giderildiği, özelliklerin geliştirildiği ve deneyimin yenilendiği bir başlangıç sunar.”

Temperature 1: “Her ikisi de uzun bir bekleme sürecinin ardından yenilikleri, iyileştirmeleri ve tazelenmeyi beraberinde getirir; ancak kullanıcılar yine de birkaç “bug”la karşılaşmaya hazırlıklı olmalıdır. 🌸💻”

Birincisi güvenli ve öngörülebilir; ikincisi ise emoji kullanacak kadar yaratıcı.

Kod yazarken genellikle düşük sıcaklık tercih edilir. Böylece modelin daha tutarlı ve öngörülebilir çıktılar üretmesi sağlanır. Ancak alternatif çözümler keşfetmek istediğiniz durumlarda biraz daha yüksek değerler faydalı olabilir. Beyin fırtınası yaparken yüksek sıcaklık istersiniz, sürpriz fikirlerle karşılaşma ihtimaliniz artar. Her ne kadar artık çoğu sistem bu ayarı arka planda yönetir hale geldiyse de nasıl olduğunu bilmek, neden bazen “robotik” bazen “uçuk” cevaplar aldığınızı anlamamızı sağlar.

4. Halüsinasyon: Neden Bu Kadar Özgüvenli Yanlış Söylüyor?

LLM bir ansiklopedi değildir. Bilgiyi ezberleyip geri çağırmaz. Her token üretiminde “bir sonraki en olası token ne?” sorusunu cevaplar. Bu bir olasılık hesabıdır, bilgi çağırma değil.

İşte halüsinasyon tam da buradan doğuyor. Model, istatistiksel olarak “doğru görünen” ama gerçekte var olmayan bir cevap üretebilir. Olmayan bir kütüphane adı verir, uydurma bir kaynak gösterir — ve bunu son derece ikna edici bir dille yapar. Çünkü onun işi ikna edici metin üretmektir, doğru bilgi vermek değil.

Neden önemli: LLM çıktısına “doğru” diye güvenmek yerine “makul” diye yaklaşmak gerekir. Kritik bilgileri her zaman doğrulamalısınız.

Bu Bilgiler Ne İşinize Yarar?

Bu kavramları bilmek sizi “yapay zeka kullanıcısı”ndan “bilinçli yapay zeka kullanıcısı”na taşır. Context window sınırını bildiğinizde konuşmayı ne zaman sıfırlamanız gerektiğini anlarsınız. Halüsinasyonu bildiğinizde çıktıyı kör güvenle kabul etmezsiniz. Temperature’ı bildiğinizde aracı iş tipine göre ayarlarsınız.

LLM bir düşünce makinesi değil, bir tahmin makinesidir. Ama nasıl tahmin ettiğini bilirseniz, tahminlerini sizin lehinize çalıştırabilirsiniz.

Peki bu sınırlar nasıl aşılıyor? RAG, Tool Use, Agentic AI — sektörün bu kavramların üzerine inşa ettiği yaklaşımları bir sonraki yazıda ele alacağız.

Siz bu dört kavramdan hangisinin eksikliğini günlük kullanımınızda daha çok hissediyorsunuz? Bağlamın unutulması mı, yoksa halüsinasyonlar mı?